Einleitung: Das Ende der Unschuld im Video-Ökosystem

YouTube ist längst nicht mehr nur ein Hosting-Service für Musikvideos, Tutorials oder Katzenclips. Mit über 500 Stunden Videomaterial, die jede einzelne Minute auf die Server geladen werden, ist es die wohl mächtigste Infrastruktur der globalen Aufmerksamkeitsökonomie. Es ist ein hochkomplexes, datengetriebenes Ökosystem, in dem täglich Milliarden fließen, Karrieren über Nacht durch virale Spikes geschmiedet und ebenso schnell durch orchestrierte Shitstorms wieder vernichtet werden. In diesem gigantischen digitalen Raum werden ethische Grenzen nicht nur regelmäßig neu verhandelt, sie werden systematisch, berechnend und algorithmisch getrieben überschritten.

Die zentrale Frage, die über diesem gesamten Konstrukt schwebt, ist simpel in ihrer Formulierung, aber erschreckend komplex in ihrer Beantwortung: Reichen Klicks, Traffic und Retention aus, um alles zu rechtfertigen?

Wir sprechen hier nicht über subjektive Geschmacksfragen. Niemand muss einen Creator mögen, dessen Stil laut, grell oder provokant ist. Es geht um etwas Fundamentales: Darf man alles filmen, veröffentlichen, durch Werbung monetarisieren und in Reichweite ummünzen – solange die Analytics stimmen? Darf man andere Menschen in dramatische, existenzbedrohende Situationen bringen, ihre Privatsphäre wie eine Ressource abbauen, Lügen verbreiten oder Halbwahrheiten als absoluten Fakt framen – nur weil das maschinelle Learning der Plattform dieses Verhalten mit einer erhöhten Ausspielung belohnt?

Die kurze Antwort lautet: Nein. Die analytische Antwort erfordert einen tiefen Blick in den Maschinenraum der Plattform. Wer auf YouTube erfolgreich sein will, spielt nach Regeln, die in keinem Community-Guideline-PDF stehen. Sie sind tief im Code des Recommendation-Systems festverdrahtet. Und diese Regeln haben verheerende Konsequenzen für Millionen von Zuschauern und die Gesellschaft als Ganzes.

Das Drama-Backend: Warum Kontroverse das stabilste Geschäftsmodell ist

Das Drama-Modell funktioniert. Es funktioniert so beängstigend gut, dass es für eine ganze Industrie von Creatorn zum profitabelsten Geschäftsmodell geworden ist. Und das passiert nicht, weil diese Menschen von Grund auf böswillig sind, sondern weil das System genau dieses Verhalten belohnt, skaliert und monetarisiert.

Stellen wir uns den YouTube-Algorithmus nicht als mystische Entität vor, sondern als das, was er technisch ist: Ein extrem effizientes, durch Reinforcement Learning trainiertes neuronales Netz. Sein einziges Ziel ist die Maximierung von Session-Watch-Time und Ad-Impressions. Die Maschine misst Aufmerksamkeit. Sie hat keine Parameter für journalistische Qualität, für den Wahrheitsgehalt oder die ethische Integrität eines Videos. Sie misst Click-Through-Rate (CTR), Average View Duration (AVD), Scroll-Stop-Raten und Engagement-Metriken (Likes, Dislikes, Kommentare, Shares).

Ein Video, das Zuschauer wütend macht, sie empört oder polarisiert, erzeugt einen massiven Anstieg in diesen Metriken. Wut ist ein unschlagbarer Dopamin-Trigger. Wenn zwei Creator exakt die gleiche Reichweite besitzen und der eine ein fundiertes, zweistündiges Interview veröffentlicht, während der andere ein 15-minütiges „Exposé“ über einen Kollegen droppt, wird das Exposé das Interview in fast allen Analytics vernichten. Nicht, weil das Publikum zwangsläufig dumm ist, sondern weil die Architektur der Plattform emotionale Reaktionen über kognitive Reflexion stellt. Die KI lernt: Dieses Video erzeugt eine emotionale Reaktion, die den User daran hindert, die App zu schließen. Also pusht sie es in Millionen weitere Feeds.

Die historische Content-Militarisierung und A/B-Testing

Dieses Drama-Modell ist keine spontane Erfindung der letzten Jahre. Wir beobachten seit geraumer Zeit eine kontinuierliche Entwicklung, die wir als „Content-Militarisierung“ bezeichnen können. In den Anfangsjahren waren YouTube-Dramen harmloses Rauschen: Ein Creator kritisierte einen anderen, es gab ein Antwortvideo, die Community diskutierte in geordneten Bahnen.

Dann eskalierte die Mechanik durch die Professionalisierung der Kanäle. Mit der Einführung von massiven A/B-Testing-Tools für Thumbnails und Titel lernten Creator, genau zu messen, welcher Grad an Toxizität den höchsten Return on Investment bringt. Das „Exposé“-Video wurde zum datengestützten Standardformat. Creator begannen, private Sprachnachrichten zu leaken, Screenshots aus Chat-Verläufen als Beweise zu stilisieren und persönliche Zerstörung als Content-Säule zu etablieren. Die Linie zwischen legitimer Kritik und digitaler Hexenjagd verschwand.

Der entscheidende Katalysator war die Monetarisierung. Durch die extreme Watch-Time solcher Dramen schossen die RPM-Werte (Revenue per Mille) in die Höhe. Das Exposé mutierte von einem toxischen Ausrutscher zu einer hocheffizienten Business-Strategie.

Parasoziale Kriegsführung: Die Waffe der emotionalen Bindung

Um zu verstehen, warum Drama so gut konvertiert, müssen wir auf die Schnittstelle zwischen Mensch und Maschine schauen: die parasoziale Beziehung. YouTube ist darauf ausgelegt, dass Zuschauer das Gefühl haben, den Creator persönlich zu kennen. Der Blick direkt in die Kameralinse, die Vlogs aus dem eigenen Wohnzimmer – all das suggeriert Nähe und Intimität.

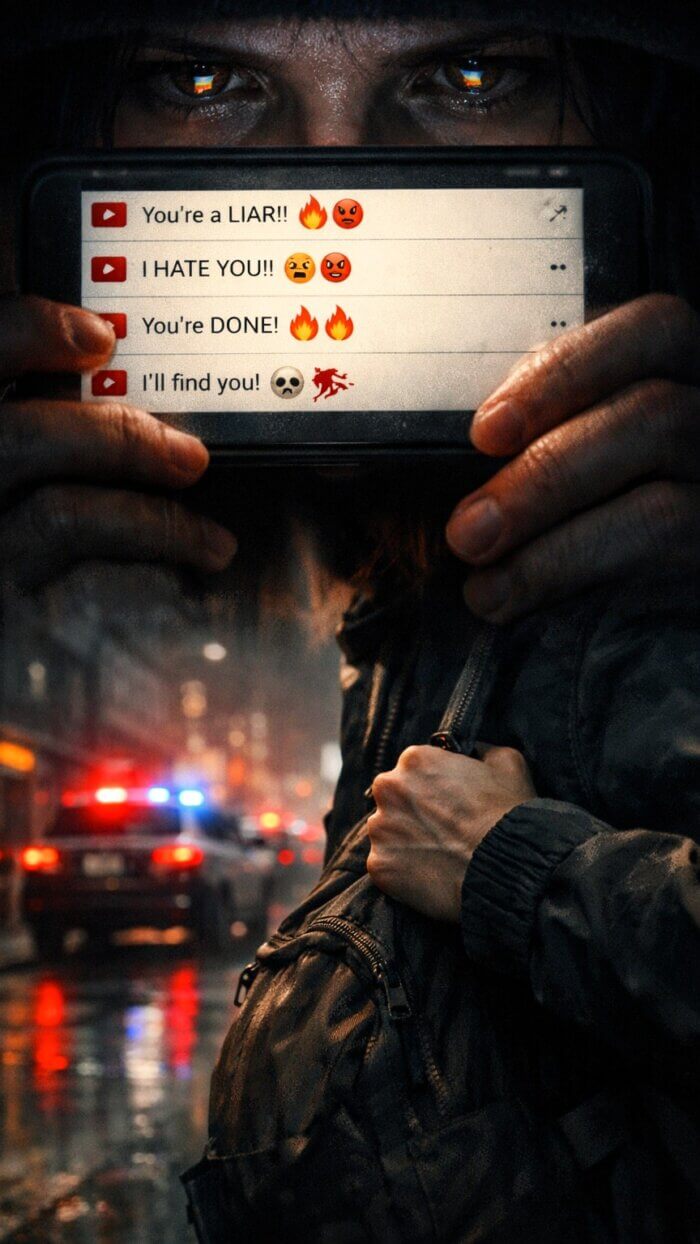

Wenn dieser Creator nun ein Drama-Video hochlädt und sich als Opfer oder als gerechter Rächer positioniert, aktiviert das bei den Zuschauern reale Beschützerinstinkte. Es ist parasoziale Kriegsführung. Der Creator lagert den Konflikt an seine Community aus. Er muss selbst keine Drohungen schreiben – seine hoch emotionalisierte, an ihn gebundene Followerschaft übernimmt das für ihn. Diese Dynamik zwingt auch andere Creator, auf den Zug aufzuspringen, um ihre eigene Relevanz in diesem überhitzten Ökosystem nicht zu verlieren. Es entsteht ein perpetuum mobile der Empörung.

Die Systematik der Grenzüberschreitung: Vier Stufen des toxischen Contents

Die ethischen Grenzüberschreitungen auf YouTube sind nicht alle gleich, aber sie bauen systematisch aufeinander auf. Sie lassen sich in vier präzise Stufen unterteilen, bevor das System endgültig kollabiert.

Stufe 1: Asymmetrische Informationskriegsführung (Halbwahrheiten und Framing)

Informationen werden so gefiltert und präsentiert, dass sie ein vordefiniertes Narrativ stützen. Ein Creator isoliert einen 10-sekündigen Clip aus einem vierstündigen Livestream und entfernt den Kontext. Er zitiert einen Tweet, blendet aber den restlichen Thread aus. Das ist toxisch, weil es asymmetrisch ist: Eine Halbwahrheit zu verbreiten, kostet Minuten und generiert massiven Traffic. Sie mit Fakten, Kontext und Quellen sauber zu widerlegen, kostet Stunden oder Tage – und interessiert den Algorithmus meist nicht mehr, weil der Skandal bereits abgekühlt ist.

Stufe 2: Der Breach der informationellen Selbstbestimmung (Doxing und Leaks)

Hier verlässt der Content die Ebene der öffentlichen Persona und greift massiv in die Privatsphäre ein. Creator veröffentlichen private WhatsApp-Nachrichten, blenden Klarnamen ein, leaken Adressen oder zeigen Gesichter von unbeteiligten Familienmitgliedern. Die Ausrede lautet stets: „Die Öffentlichkeit hat ein Recht auf die Wahrheit.“ Juristisch ist das meist ein massiver Verstoß gegen Persönlichkeitsrechte und die DSGVO. Dass Plattformen hier aufgrund von Moderations-Rückständen kaum durchgreifen, legitimiert das Vorgehen nicht – es offenbart lediglich die gravierenden Bugs in der Content-Moderation.

Stufe 3: Die Instrumentalisierung von Schutzbefohlenen

Die dunkelste digitale Eskalationsstufe: Creator, die Kinder und Jugendliche aktiv in ihre Drama-Produktionen einbauen. Ob als weinende „Beweisstücke“ in einem öffentlichen Sorgerechtsstreit, als Zielscheibe für Spott oder als emotionaler Hebel, um andere Creator unter Druck zu setzen. Hier darf es keine Grauzone und keine Diskussion geben: Ein Kind kann keine informierte Einwilligung (Informed Consent) zur Veröffentlichung von Inhalten geben, die einen dauerhaften, toxischen digitalen Fußabdruck hinterlassen. Kinder sind keine Metriken. Kinder sind keine Content-Ressource für das nächste virale Thumbnail.

Stufe 4: Der Kollaps der Realität (Inszenierte Konflikte und Fake-Drama)

Die völlige Loslösung von objektiven Fakten. Geschichten werden von Grund auf erfunden, Konflikte hinter den Kulissen vertraglich abgesprochen, Sprachnachrichten per KI (Voice Cloning) gefälscht, Accounts für inszenierte Shitstorms über Bot-Netzwerke gekauft. Das Ziel ist reines Engagement-Farming. Wenn die User-Base nicht mehr verifizieren kann, was real und was gescriptet ist, erodiert das Grundvertrauen in die gesamte Plattform. Davon sind am Ende auch die Creator betroffen, die echte, fundierte journalistische Arbeit leisten.

Der Breach in die Realität: Stochastische Gewalt und der Fall Battermann

Bis hierhin haben wir über digitale Mechaniken, Server-Infrastrukturen und Metriken gesprochen. Aber es gibt eine absolute rote Linie, die gerissen wird, wenn die Toxizität den Bildschirm verlässt. Wenn aus Bits und Bytes reale Taten werden. Wenn der Online-Beef nicht mehr virtuell bleibt, sondern zu realen Angriffen auf reale Menschen führt.

Hier hört das Thema auf, eine theoretische Medienanalyse zu sein. Aktuell dokumentieren Kanäle wie Die Fernsehschatztruhe oder Maren Giertz eine erschreckende Entwicklung: Reale, physische Angriffe – wie im Fall von Frank Battermann von YouTube Kanal Die Fernsehschatztruhe –, deren Hintergrund untrennbar mit YouTube-Konflikten verknüpft ist.

Jemand wird körperlich angegriffen, weil er Teil einer YouTube-Kontroverse ist. Nicht als Metapher. Nicht als Cyberbullying. Sondern als handfeste, physische Gewalt. Wir sprechen hier von stochastischer Eskalation. Ein Creator muss nicht explizit zu Gewalt aufrufen. Es reicht völlig, wenn er eine Community von 500.000 Menschen über Wochen hinweg mit Wut, Hass und Doxing-Material füttert. Rein statistisch gesehen wird sich in dieser Masse mindestens ein Knotenpunkt finden, der psychisch instabil genug ist, um die Aufforderung zur Zerstörung wörtlich zu nehmen.

Das entzaubert alle branchenüblichen Relativierungen auf einen Schlag:

- „Ist doch nur Content“ – Nein, es ist kein Content mehr, wenn Menschen in der Notaufnahme liegen.

- „Die Zuschauer können ja wegschalten“ – Nicht, wenn der Hass vor der eigenen Haustür steht.

- „Der Algorithmus regelt“ – Der Algorithmus hat keine Ethik, kein Gewissen und übernimmt vor allem keine strafrechtliche Haftung.

Das Protokoll der Eskalationsleiter

Wie wird aus einem Video ein physischer Angriff? Diese Mechanik folgt einem klaren, messbaren Protokoll:

- Der Content-Konflikt: Zwei Creator geraten aneinander. Videos werden hochgeladen. Der Konflikt ist noch rein digital und auf die Plattform beschränkt.

- Die Community-Mobilisierung: Die parasoziale Armee formiert sich. Zuschauer werden zu Akteuren. Sie fluten die Gegenseite mit Dislikes, Reports und massenhaften Hasskommentaren. Der Creator steuert dies oft durch subtile Calls-to-Action („Schaut mal bei ihm vorbei und sagt ihm eure Meinung“).

- Die Personalisierung (Doxing): Die Firewall zwischen Online-Persona und Zivilperson fällt. Bürgerliche Namen, Wohnadressen, Arbeitgeber und familiäre Strukturen werden geleakt und in Telegram-Gruppen oder Discord-Servern verteilt.

- Der Systemkollaps (Reale Gewalt): Jemand wird erkannt, konfrontiert und angegriffen. Auf der Straße. In der realen Welt. Mit echten Verletzungen.

Und die Creator, die dieses Feuer wochenlang mit Content am Brennen gehalten haben? Die sitzen sicher im schallisolierten Studio, schneiden das nächste Video und zählen die AdSense-Einnahmen. Der Täter auf der Straße agiert nicht in einem Vakuum. Er agiert in einem emotionalisierten System, das von Creatorn und Algorithmen als hocheffizientes Geschäftsmodell gezüchtet wurde.

Die Mitschuld der Zuschauer und das Märchen vom „freien Markt“

Wenn tausende Zuschauer eine koordinierte Hasskampagne fahren, ist das keine „freie Meinungsäußerung“ mehr. Es ist gezielte digitale Gewalt, oft ausgeführt wie ein Distributed Denial of Service (DDoS)-Angriff, nur eben auf die menschliche Psyche. Wer in einer solchen Community Hass verbreitet, trägt Verantwortung für die Konsequenzen. Auch wer „nur“ zuschaut und durch Watchtime den Algorithmus füttert, ist ein aktiver Node in diesem toxischen Netzwerk. Schweigen ist Zustimmung. Klicken ist Unterstützung.

Das Standardargument der Creator lautet an dieser Stelle oft: „Der Markt regelt das. Wenn die Leute es nicht sehen wollen, produzieren wir es nicht.“ Das ist analytisch kompletter Unsinn. Der YouTube-Algorithmus formt keinen freien Markt; er ist eine extrem gesteuerte, zentralisierte Ökonomie. Die Auswahl der User ist präselektiert auf Basis historischer Klickdaten, die den Nutzer in einer algorithmischen Echokammer der Empörung gefangen halten. Wenn ein hochwertiges, differenziertes Video vom System aussortiert wird, weil die CTR in den ersten 60 Minuten zu niedrig war, existiert es für 99 % der Nutzer schlichtweg nicht.

Zudem ignoriert das Markt-Argument die Externalitäten. In der Wirtschaft spricht man von negativen Externalitäten, wenn die Kosten eines Produkts von Dritten getragen werden (wie bei der Umweltverschmutzung durch Fabriken). Auf YouTube streicht der Drama-Creator den Profit ein, während die Zielperson des Exposés – oder im schlimmsten Fall physische Opfer wie Frank Battermann – den psychischen und physischen Preis zahlen. Der Verursacher profitiert, die Gesellschaft trägt den Schaden.

Architektur-Fixes: Ein technischer und ethischer Blueprint

Nachdem wir gesehen haben, wie tief der fehlerhafte Code in die Realität einschneidet, reicht es nicht, nur zu kritisieren. Wir brauchen handfeste Architektur-Fixes. Weder Plattform noch Creator dürfen sich länger hinter der „Safe Harbor“-Ausrede verstecken.

- Algorithmische Audits durch Drittparteien: Der Algorithmus darf keine Blackbox mehr sein. Es braucht unabhängige Schnittstellen (APIs) für Forscher und Regulierungsbehörden, um zu prüfen, ob die KI systematisch extremistische oder toxische Inhalte priorisiert.

- Plattform-Haftung für Community-Verhalten: YouTube muss Creator für systematisch toxische Communities haftbar machen. Nicht erst nach einem realen Angriff, sondern wenn das Doxing beginnt. Eine Community, die doxt, muss zur sofortigen Sperrung des Kanals führen.

- Harte wirtschaftliche Konsequenzen: Ein Community-Strike und eine Entschuldigung vor der Kamera reichen nicht. Wer nachweislich Persönlichkeitsrechte verletzt oder gezielt eskaliert, muss auf Kanalebene demonetarisiert werden. Wer das System missbraucht, wird hart von der AdSense-Infrastruktur abgeklemmt. Ohne Cashflow trocknet das Drama aus.

- Konsequente Strafverfolgung: Online-Drohungen und Doxing müssen als das behandelt werden, was sie sind: handfeste Straftaten. Polizei und Justiz müssen technisch aufgerüstet werden, um Täter hinter anonymen Accounts zu identifizieren. Wer durch Videos systematisch aufhetzt, muss rechtlich als Anstifter greifbar sein.

- Aktive Creator-Verantwortung: Ein „Bitte nicht haten“ in der Videobeschreibung ist wertlos. Creator müssen gezwungen werden, ihre Kommentarsektionen aktiv zu moderieren und toxische Akteure per Shadowban oder Hard-Block aus dem System zu werfen. Wer seine eigene Infrastruktur nicht sauber halten kann, verwirkt sein Recht auf Reichweite.

- Verpflichtende Medienkompetenz: Die Zivilgesellschaft muss patchen. Medienkompetenz muss tief in die Bildungspläne integriert werden. Die nächste Generation muss den Code der Plattformen lesen können: Jeder Klick, jede Watch-Time-Sekunde, jeder Kommentar ist ein Datensatz, der reale Konsequenzen hat.

Fazit: Die Metriken der Menschlichkeit

Wir müssen aufhören, Klicks und Traffic als Freifahrtschein für alles zu akzeptieren.

Views rechtfertigen keine Lügen. Retention rechtfertigt keine psychische Gewalt. Ad-Impressions rechtfertigen nicht die physische Zerstörung von Menschenleben und Familien. Das System belohnt das Drama, weil es darauf programmiert wurde – aber wir sind diejenigen, die das System mit unseren Daten füttern und die Server am Laufen halten.

Die Leitfrage für jeden, der Inhalte ins Netz lädt oder konsumiert, darf nicht mehr lauten: „Ist das juristisch gerade noch legal?“ oder „Bringt das den Algorithmus zum Glühen?“ Die Frage muss lauten: „Sollte ich das tun?“ Und wenn die Antwort auf der Ebene von Anstand, Respekt und physischer Unversehrtheit „Nein“ lautet, dann drückt man nicht auf „Publish“. Auch wenn es 500.000 Klicks und ein massives Sponsoring kosten würde.

Denn am Ende des Tages ist der Code, den wir im Netz hinterlassen, der Code, nach dem unsere reale Gesellschaft funktioniert. Ein Bug in der digitalen Ethik wird unweigerlich zu einem Crash in der realen Welt.

Euer Sascha